COPU会议纪要丨2025.01.21

COPU开源联盟 2025年01月21日 14:23 北京

1月20日陆立席主持召开COPU例会。

本次会议发表伊里亚(Ilya)在NeurIPS 2024年会上的主题演讲“数据是人工智能的化石燃料”以及COPU 对伊里亚演讲的注解和点评。

伊里亚·萨斯卡弗(Ilya Sutskever)的演讲

他在演讲中提出:我们现在依赖强大的人工智能(语言大模型LLM),未来会走向何方?我们现在是否已触及了数据时代的顶峰?

他回顾过去十年,预测AI的未来。

他首先谈到他的核心观点:

① LLM的预训练行将结束,

② 数据是人工智能的化石燃料,

③ 超级智能是人工智能的未来,

④ 超级智能的演化步骤是:代理、推理、理解和自我意识,

⑤我们将来要处理的AI系统将是高度不可预测的。

接着,他回顾10年前(2014年)的一次演讲(在蒙特利尔的 NeurIPS 会议上),他说:那时我还很天真(与现在对比,现在我看起来更成熟、更有经验),10年前我们有很多观点是正确的,但也有一些不太正确,回顾一下看到今天这些观点是如何逐渐演变的。

在10年前那次演讲中,我谈到我们做了三件事:

l构建了一个基于文本训练的自回归模型,

l使用了一个大型神经网络,

l使用了大型数据集

在10年前的演讲中,我们提出深度学习“假设”:如果有一个大型神经网络,它包含很多层(当时最多能做到10层它能在不到1秒的时间内完成人类可以完成的任何事情(表示人类能快速完成的事情)。

我们提出这个“假设”的前提是:我们认为人工神经元和生物神经元是相似的,并且神经元的动作是缓慢的;这个“假设”的逻辑是:如果任何人类在1秒钟内可完成的事情,一个大型10层的神经网络也可以做到的话,这时你只需要提取它们的连接方式,然后将其嵌入到人工神经网络中,我们就会知道我们是如何来训练10层自回归神经网络的;这时我们的核心思想是:这里正在发生自回归的过程,我们能很好地预测下一个token,实际上会捕获、抓住下一个序列的正确分布。这在当时是一个比较新的想法(但并不是第一个自回归神经网络),但我认为,这是第一个使我们相信如果训练得足够好,就能得到任何想要的自回归神经网络。我们当时的目标是做好机器翻译。

接下来,我要展示一些你们很多人可能从未见过的古老历史:LSTM(这是一项 Transformer之前的技术,也是可怜的深度学习研究人员使用的东西),它基本上是一个旋转了90度的 ResNet。你可以看到它集成了残差连接(现在被称为残差流)。另外我还想强调的一个特点是并行计算。我们在每个GPU处理层使用了管道并行。现在看来,使用管道并行并不明智,通过使用8个GPU,当时我们获得了3.5倍的速度提升。这时阐述了规模化假说的开端:如果你有非常大的数据集,并且训练非常大的神经网络,那么成功是必然的。

我还想提一个理念,即连接主义,这个理念经受了时间的考验。连接主义的核心理念是:如果你相信人工神经元有点像生物神经元,那么你就有信心相信大型神经网络(即使它们不完全像人类大脑那么大)可以被配置来完成我们人类所做的大部分事情,当然还是有差异,因为人类大脑会自我重构,而我们现在最好的学习算法需要大量的数据。人类在这方面仍然更胜一筹。我认为所有这些都引领了预训练时代的到来。在我的前合作者帮助下,在GPT—L模型、GPT—3模型、缩放法则中,使用的预训练是今天我们看到所有进步的驱动力。超大型的神经网络在海量数据集上训练。

现在谈谈预训练的终结。即预训练终将结束,为什么?因为虽然算力在不断增长,但我们只有一个互联网!你可以说,数据是人工智能的化石燃料,它被创造出来,我们使用它,并且已经达到了数据峰值,不会再有更多的数据了,因为我们只有一个互联网,但我们还有很多路要走,需要解决更多的数据来源的问题。

接下来谈谈在预训练结束后我们尝试要做的研究任务:

① 智能体(agents)是AI的未来。

我们正在研究真正的智能体。现在在任何有意义层面上的所谓智能体都还不具有真正的智能性质的智能体,或者只有非常微弱智能的智能体。

②合成数据。如何生成有用的合成数据仍是一个巨大的挑战。

③推理时的算力优化。

一个系统越进行推理,社会变得越不可预测。我们现在使用的模型都是不可预测的,因为我们一直在努力复制人类的直觉(可谓我们大脑在1秒钟内反应本质上就是人类的直觉)。因为推理是不可预测的,正如对人类的国际象棋高手来说,好的国际象棋AI系统是不可预测的,这是目前有限数据条件下存在的局限。我们如何摆脱这种局限,我相信大模型如果有与其自我意识相结合的能力时,我们将拥有与今天截然不同的系统,将拥有难以置信的能力,变过去的“预测未来不能”为“一切皆有可能”。

④协调现在语言大模型强大的功能与其负面表现之间的矛盾。

今天我们拥有强大的语言模型,有很棒的聊天机器人,在完成某些任务时具有超人表现,但它也常常不可靠,有时会感到困惑。

⑤超级智能。

超级智能将与我们今天拥有的智能截然不同。

下面是问答环节:

问题1,生物结构与人类认知

问:在2024年,是否有其他生物结构在人类认知中发挥作用?您认为值得像您之前那样去探索?

答:如果有人对大脑的运作方式有独特的见解,并且认为我们目前的做法是愚蠢的,他们应该去探索它。我们认为,生物学启发人工智能是非常成功的,因为所有的神经网络都是受生物启发的,尽管其灵感非常有限,比如我们只能使用了神经元,更详细的生物灵感很难找到。

问题2,推理和自我纠正

问:您提到推理是未来模型的核心,我们看到现在模型中存在幻觉,我们使用统计分析来判断模型是否产生幻觉,未来,具有推理能力的模型能否自我纠正减少幻觉?

答:我认为你描述的情况是极有可很发生的。事实上,有些早期的推理模型可能已经开始具备这种能力了。长期来看,为什么不能呢?!这就像微软 Word中自动更正功能。当然这种功能比自动更正要强大得多。但总的来说,答案是肯定的。

问题3,超级智能的权利和激励机制

问:如果这些新诞生的智能体需要权利,我们应该如何为此建立正确的激励机制,以确保它们像人类一样获得自由?

答:这是一个值得人们思考的问题,但我并不觉得我有能力回答这个问题,因为这涉及到要建立某种自上而下的结构,包括政府在这种结构上层所起的作用;如果AI只是想与我们共存,并想在其中获得权利,也许可用加密货币来处理这个问题更好。

问题4, 的多跳推理泛化能力

问:您认为大型语言模型(LLM)是否能够进行多跳推理的跨分布泛化?

答:这个问题不应该用“是”或“否”来回答。你说的“跨分布泛化”、“在分布内泛化”是什么意思?在深度学习前,人们使用学符串匹配、n-gram等技术进行机器翻译,在当时“泛化”意味着是否使用完全不在数据集中的短语?现在我们的标准已经大幅提高。

如果一个模型在数学竞赛中取得了高分,也许它只是记住了互联网论坛上讨论过的想法,所以,也许它是在分布内,也许只是记忆。现在人类的泛化能力要好得多,能够取得一个更合理的答案。

对伊里亚演讲的注解和点评

COPU 2025.1.10

伊里亚·萨斯哥弗(Ilya Satskever)是人工智能大师杰夫里·辛顿(Geoffrey Hinton)的学生,也是一位知名的人工智能专家,他是OpenAI的创始人之一,曾任该公司的首席科学家。

他在《神经信息处理系统2024年会(NeurIPS2024)》上接受领奖时,作了“数据是人工智能化石燃料”(Data is the fossil fuel of AI)的主题演讲。他在演讲中回顾了人工智能发展的过去,谈到了现在,并展望将来。

为了便于读者更好理解他的演讲,COPU谨对他演讲中的一些核心观点进行注解和点评。

伊里亚认为,现在的人工智能语言大模型(LLM)是基于深度学习发展起来的。

COPU注解:语言大模型是基于深度学习算法(辛顿等人自创的人工神经网络是其核心技术)、采用统计学模型(其语料库中规模数量的语料为其提供化石燃料)发展起来的。

其中,人工神经网络(Artificial Neural Network,ANN)与生物神经网络相似而非相同,它成功模拟生物神经网络中的神经元的功能,但在全面、准确、高效模拟方面尚有局限;它比起后来建立类脑的脉冲神经网络(Spiking Neural Network,SNN)也有差距。

伊里亚谈到语言大模型的预训练行将结束。

COPU注解:供大模型“预训练”之用的语料数量的增长将导致大模型推理能力的增长。语料的参数量开始取自日常数据,继而取自行业内专用的大数据,后来又取自互联网的海量数据,这时自然取得的参数量已经到顶(GPT-4达Token 1.76万亿, Llama达 Token 2万亿, Falcon达 Token3.5万亿,总之互联网海量数据 Token约几万亿),宣告了预训练的终结。

为了满足进一步提高推理能力(进而提高大模型智能)的需要,人们将越过从互联网自然取材的海量数据的顶峰,自产数量级约为 Token几百万亿的合成数据,自GPT 1o开始应用,从而开辟了“后训练”的新时代。

伊里亚认为,人工智能的未来是超级智能,而超级智能的演化步骤是代理、推理、理解和自我意识。他还认为,智能体(agents)是AI的未来,推理是未来AI的核心,但推理是不可预测的。他还就推理是否能产生自我纠正能力、大模型能否产生自我意识、未来大模型是否具有预测能力、以及如何赋予超级智能权利等问题,进行思考。

COPU注解:大模型推理能力的提高是会产生自我纠正能力的,从而减少或消除大模型产生“幻觉”的负面效应。大模型如果能摆脱有限数据条件的局限,采用类脑神经网络并发挥其作用,导致大模型产生自我意识完全是可能的。而具有自我意识的大模型才会产生预测能力。

伊里亚没有谈到未来AI与人类的关系问题。

不久前COPU尝列举几位人工智能大师的看法:①人类+agents应对AI,②人类与AI是协同合作关系,③人类设置安全红线应对AI。这是一个关系到人类安全和利益的重大课题,有待于稳妥解决。

最近看到李飞飞大师最新的访谈;她在谈到人类与AI的关系时强调:无论如何要确保人的主体性和能动性,把AI看作为“强大”的工具,这些工具用于增强人的能力而非替代,使人类能够更精确地利用这些工具完成任务,我们将看到更多的(人类与AI)的协同能力将展现出来。如此看来,李飞飞的观点属于上述人工智能大师看法的第②类。

今天我看到OpenAI奥特曼(Sam Altman)的一个疯狂的讲话(我觉得可信度不高,但也列出来供大家参考):

他说,目前AI已跨越了自我进化的临界点,恐怖的AI自我进化可能已经开始了。目前人类的智商水平已低于AI。人类文明的所有数据均被AI超越,人类用以训练AI系统的数据已经用尽,现在由AI产生、使用大量合成数据,用以训练 AI自己(实现自我合成、自我训练、自我优化、自我进化)。将来最强的AI不是由人类创造,而是由AI创造,将来会出现超过人类一万倍的超级智能ASI,ASI有两大特点:一是自我进化,二是进化特别快。在短短几个小时内就能完成从AGI向ASI的飞跃。由AI完成的基于AI的自动设计,谷歌已在应用,AI自己设计出来的AI思维链CoT已完成。

如果我们问奥特曼,未来的AI干什么?他似乎不敢说毁灭人类,更未谈人类是否能提出自保的安全保障措施,只是谈到AI将可搞科研工作。

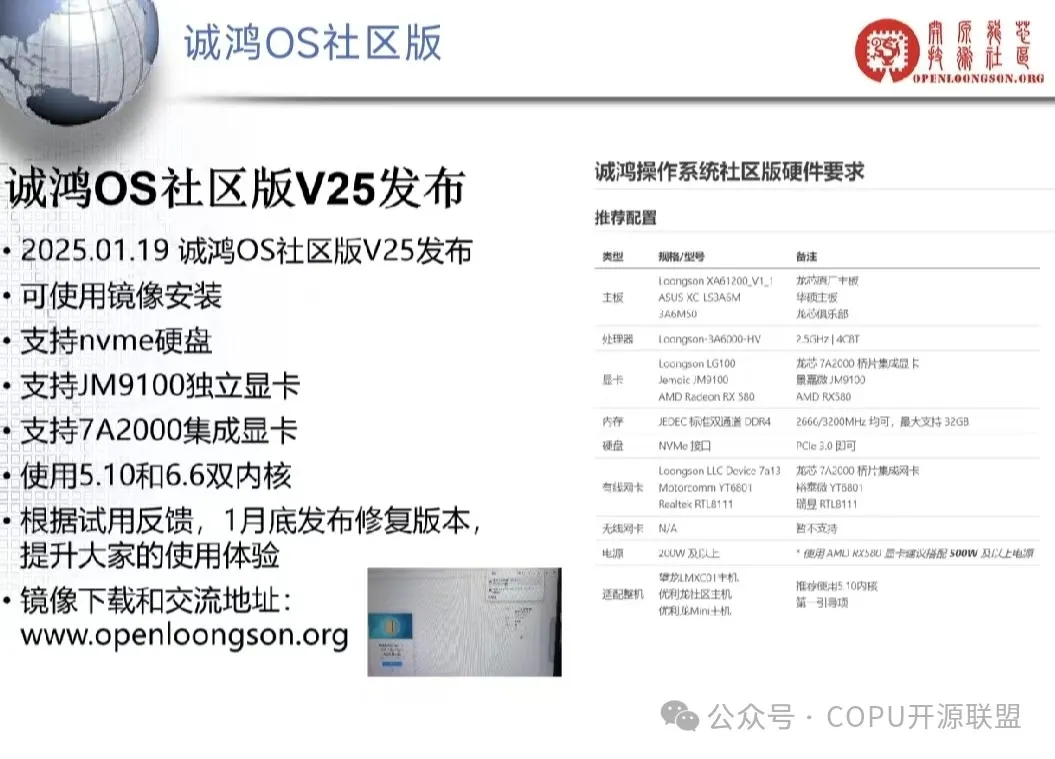

本次会议听取了龙芯俱乐部和诚迈科技关于研制“龙芯开源鸿蒙PC”(诚鸿OS V25/开源鸿蒙5.0)的汇报。

本次会议听取了龙芯俱乐部和诚迈科技关于研制“龙芯开源鸿蒙PC”(诚鸿OS V25/开源鸿蒙5.0)的汇报。

参会人员:陆首群、章文嵩、宋可为、程海旭、陈伟、袁怿、安泱、朱晓红、张侃、谭中意、石南、陈海涛、杨科、刘夏、刘巍巍、鞠东颖、刘澎(线上)、陈钟(线上)、陈越(线上)、陈道清(线上)、韩宪平(线上)、李宏博(线上)。