COPU会议纪要丨2025.08.19

8月19日陆主席主持召开COPU例会。

本次会议听取陈钟、谭中意小组汇报:国内顶尖的大模型是否能进入世界大模型排行榜的前列位置?谭中意在会上介绍最新发布的三个排行榜:

Lm arena.ai/ Text Arena 2025.8.15

文本能力排行榜

1)GPT-5- high (Open AI)

2)Gemini-2.5-pro (Google)

2)03-2025-04-16 (Open AI)

2)Claude Opus-4-1-20250805 (Anthropic)

4)Chat GPT-4o-latest-20250326 (Open AI)

4)GPT-4.5- preview (Open AI)

5)GroK-4 (XAI)

5)Qwen3-235b-azzb-instruct2507 (阿里云)

7)Kimi-K2-0711-preview (月之暗面)

7)Claude-4-thinking16k20250514 (Anthropic)

LMSYS Chatbot Arena 2025.8.1

1)Gemini-2.5-pro (Google)

1)03-2025-04-16 (Open AI)

2)Chat GPT-4o-latest-20250326 (Open AI)

2)GPT-4.5- preview-2025-02-27 (Open AI)

3)Qwen3-235b-azzb-instruct2507 (阿里云)

4)GroK4-0709 (XAI)

5)Kimi-K2-0711-preview (月之暗面)

5)Claude-opus-4-20250514 (Anthropic)

6)Deepseek-R1-0528 (深度求索)

7)Claude thinking-16K (Anthropic)

LM Arena 开源大模型排行榜 2025.7.21

1)Qwen3 (阿里云)

2)Kimi-k2 Ontex2 (月之暗面)

3)Deepseek-R1 (深度求索)

4)Gemma 2.9b (Google)

5)Llama 370b(Meta)

国内顶尖的大模型是否能进入世界大模型排行榜的前列位置?

国内顶尖大模型在国际上的水平如何?

陈钟、谭中意小组认为:全球人工智能(AI)市场正经历前所未有的指数级增长,预计到 2030 年将达到1.81 万亿美元,复合年增长率(CAGR)高达 35.9% 。其中,以大型模型为代表的生成式 AI 是这一增长的核心驱动力,推动了企业和消费者层面的广泛应用。在这一快速演进的格局中,美国进入了“第一梯队”,中国正在追赶第一梯队,中美均遥遥领先于其他国家。

中国在AI 大模型领域展现出显著的进步,尤其在算法创新方面,其领先的大模型正在迅速缩小与美国顶级专有模型之间的性能差距,在关键基准测试上已接近持平。中国还在全球开源 AI 生态系统中占据主导地位,其模型在国际排名中名列前茅。此外,中国拥有庞大的国内市场、多样化的应用场景以及积极主动的国家主导型产业政策,这些都促进了人才培养和基础设施建设。

然而,中国也面临着严峻的挑战,主要体现在算力基础设施方面,由于美国对先进AI 芯片的出口管制,中国在一定程度上依赖性能较低的国产替代品,并面临供应链脆弱性。尽管国内芯片生产正在增长,但关键瓶颈在于软件生态系统和工具链的滞后。与美国相比,中国在AI 私人投资方面也存在显著差距,并且在高价值专利产出方面仍需提升。

为了克服这些劣势并实现全球领先,中国必须优先采取以下战略:加速国内芯片研发并强化软件生态系统;提升数据质量并有效利用合成数据;在加强基础算法研究的同时,巩固开源领域的领导地位;扩大和完善AI 人才培养与留存策略;以及深化 AI 在各行各业和公共服务领域的融合,尤其是在高价值、复杂场景中的应用。此外,建立一个健全、适应性强、兼顾创新、安全与伦理的 AI 治理框架也至关重要。

展望2025 年,AI 产业将迎来“智能体元年”和“应用加速落地之年”,标志着从基础模型开发向广泛实际部署的转变。中国能否将技术突破与成熟的生态系统和深度应用相结合,将决定其迈向全球 AI 领导地位的轨迹。

在本次会议上谭中意汇报的要点是:

①谷歌、OpenAI、X-Al处于世界大模型发展的第一梯队,中国的DeepSeekR1、KlMl2、Qwen等大模型还不是第一梯队,正在追赶第一梯队!②发展大模型,中国在算法、算力、数据、人才等方面正在加快追赶,吸引、凝聚人才的关键是改善人才的基础设施。

稍后请华为汇报如何提高算力的问题。

丁蔚邀昇腾专家王震军,汇报讨论提升华为算力问题。

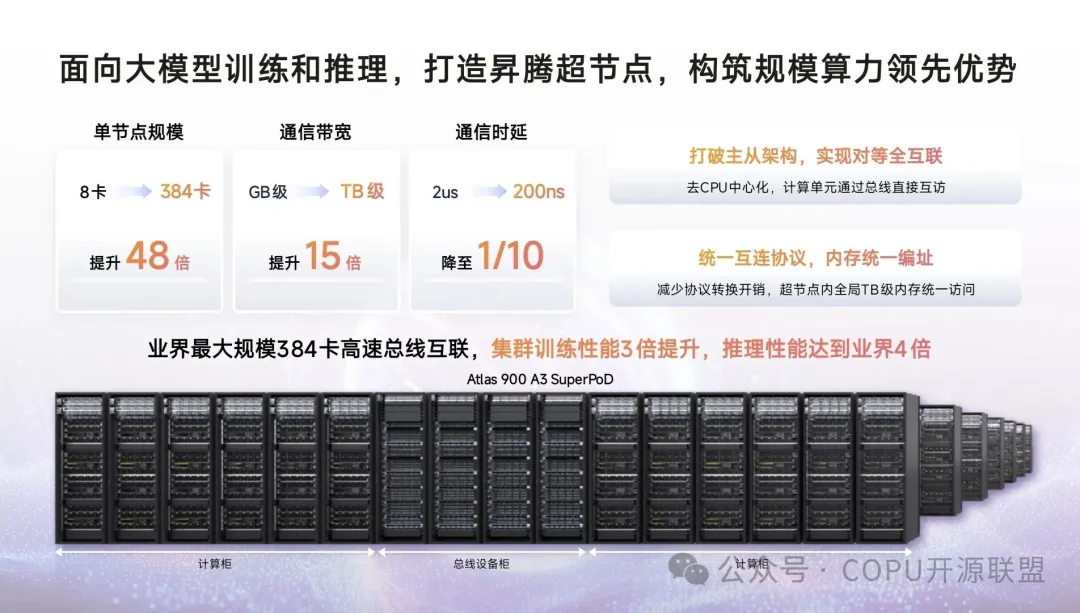

王震军汇报华为主攻算力芯片集群在多个超节点方面解决其总线互联架构改革,如CloudMatrix384,提高其系统效率,从而提高系统算力。建设万卡算力集成服务中心就是采用多个超节点互联集成的。在谈到针对提高单芯片算力采取CANN时,实行开源,并挑战英伟达的CUDA。陆主席要求他汇报一下CANN目前在实用上进展如何?并要求华为昇腾团队接纳由COPU推荐的会员企业和个体入内协同,丁蔚、王震军均表赞同。

大模型MoE主流架构其复杂混合并行策略对集群的跨机互联和带宽带来很大挑战。华为昇腾创新提出了对等计算架构,在超节点范围内,通讯带宽提升提升了15倍,单挑通讯时延降到200纳秒,对超节点内如一台计算机工作。384超节点由12个计算柜和4个总线柜组成,性能测试数据显示运行LLAMA3等千亿稠密模型性能提升2.5倍,通信更高的Qwen,Deepseek等多模态、MoE模型性能提升三倍以上,目前已经在华为昇腾云和多家万卡集群中商业部署。

本次会议摘录陈渝老师的文章(其中摘要已由上次例会袁怿讲解):

当前计算领域正经历一场深刻的范式转变,传统操作系统(OS)正在向以人工智能(AI)为核心的新一代智能操作系统演进。这份报告深入分析了全球领先的 IT 企业(如谷歌、微软、Meta、红帽、特斯拉、华为、VIVO、OPPO、小米、阿里巴巴、腾讯、字节跳动等)如何构建面向 AI 或大型语言模型(LLM)的操作系统,并审视了学术界在这一前沿领域的研究现状。

当前的发展现状表明,AI 操作系统不仅仅是运行 AI 应用程序的平台,其核心功能和架构本身就由 AI 驱动,实现了自适应智能、自然语言交互、自优化资源管理和 AI 代理间的共享内存。这种转变源于大型模型对计算资源、实时响应和边缘处理的巨大需求,促使操作系统从静态规则走向动态学习和预测。

各大科技公司正采取多元化策略:谷歌通过Fuchsia、Android 和ChromeOS 的 AI 深度融合以及定制TPU 构建“AI 无处不在”的生态系统;微软则通过Windows AI 和Azure AI 平台,结合Maia 等定制芯片,推行“设备端+云端”的混合AI 策略;Meta 以其对AI基础设施的巨额投资和PyTorch 的开源领导地位,旨在实现AGI 的计算主导;红帽则专注于通过其开源混合云平台,为企业提供AI 运营(MLOps/LLMOps)的基础设施支持;特斯拉则展现了高度垂直整合、面向特定应用(自动驾驶)的AI 操作系统范例;而华为、VIVO、OPPO、小米等移动设备制造商则致力于将AI 特性深度融入日常用户体验,推动 AI在设备端的普及。国内的阿里巴巴、腾讯和字节跳动则在云原生AI操作系统、LLM 优化、AI 驱动的内核优化以及新型代理间通信协议(如A2A 等)方面取得显著进展。

学术研究正从根本上重构操作系统,提出AIOS 等新架构,并专注于 LLM 性能的微观优化和 AI 特有安全漏洞的防御。这些努力共同推动了计算范式的演进,预示着一个由智能、自适应、情境感知系统主导的新时代,将重塑人机交互和技术创新。

在本次会议上,陈渝、宋可为小组由宋可为汇报AIOS研发部署问题。

会议要求,①该小组首先进行调研国内外关于AI0S项目研发动态,②对AI0S项目按服务对象、需求等进行科学分类,特别要关注Agent问题,③抓研发试点。

参会人员:陆首群、丁蔚、王震军、章文嵩、安泱、宋可为、程海旭、袁怿、谭中意、靳虹博、孟伟、张侃、马洪波、陈连虎、鞠东颖、刘澎(线上)、陈绪(线上)、陈伟(线上)、陈道新(线上)、陈钟(线上)、齐宝玮(线上)、任革林(线上)、任紫东(线上)、李弘博(线上)、朱晓红(线上)、胡宇(线上)、韩宪平(线上)、Anna.AI(线上)。