COPU会议纪要丨2026.03.03

3月3日,陆主席主持召开COPU例会。

本次会议讨论全球AI格局又一转折点。

1. 会上发表《东西方争夺编程王冠(续)》。

会上发表:《东西方争夺编程王冠(续)》

陆首群,2026.3.1

不久前(2月16日)我发表了《东西方争夺编程王冠》一文,引起热议。文中指出:东西方聚焦编程王冠之争,表面上是编程技术指标排名之争,实质上是AI行业的一次深刻的战略转向。选择编程作为主战场,背后有两大深层逻辑:最清晰的商业路径,以及通往AGI的硬核技术战略转轨。

一、当前西方主流大模型普遍采取规模扩散路径,消耗资源巨大,在人才、能源、资金、参数、算力等方面,面临日益严峻的供给压力。相比之下,DeepSeek探索出一条低成本、有限资源、高效率、高性价比发展AI的路径,训练成本仅为同类模型的数十分之一。这种“降本增效”的技术路线,不仅有效缓解了资源瓶颈,也为商业化落地提供了更具竞争力的成本结构。

二、当前生成式自回归语言大模型与真正的通用人工智能(AGI)仍有显著差距,向AGI转轨演进已成为行业共识。多模态理解、复杂任务处理(百万token长上下文窗口,以及智能体/Agent跨越多重上下文窗口)、世界模型等,也是向AGI转轨过渡的核心技术。梁文锋表示,DeepSeek V4是为Agent时代准备的模型。

最近DeepSeek联合清华北大发表重磅硬核论文,发力于当前AI发展的下一个赛道——智能体(Agent)大模型,发布智能体推理框架(Dual Path)。

智能体大模型与传统大模型的单次交互不同,它解决了传统大模型发生资源错配、预填充引擎独自承担缓存读取压力过大、网络拥堵、GPU闲置、解码引擎带宽浪费等问题。

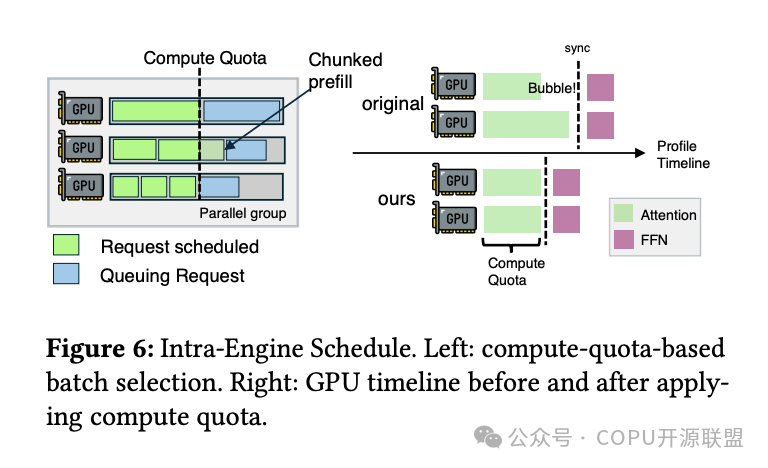

智能体大模型为完成多重超长上下文的复杂任务,开辟了大模型底座推理系统的Dual path(直接击穿Agent推理V/D瓶颈),开通了一条全新的双路加载通道(推理双路径KV-Cache)加载机制,①使数据读取与GPU代算平行,②彻底解决传统架构算力空转问题。即通过全局调度算法,打通预填充与解码节点的传统壁垒,使“存储→解码→预填充”在线服务中的吞吐量提升1.96倍(即在线Agent运行效率提升1.96倍),并巧妙利用集群中的闲置带宽,使1152张GPU算力卡在大规模集群中表现突出。

DeepSeek与清北的合作成果进一步打开了“降本增效”的大门。当前AI行业的竞争已经转向“算力效率+场景落地”的综合比拼,DeepSeek的技术方向恰好契合这一趋势。

三、DeepSeek将于3月初发布-V4 Lite(轻型版),首先向华为昇腾及其他国内芯片制造商提供这个窗口期预览版的信息和数据,做好软硬件的适配工作,确保模型在国内主流硬件上自主高效运行。

四、点评Claude Opus VS DeepSeek V4

我在不久前发表《东西方竞相争夺编程王冠》文章后,当即有人留言:希望点评Claude Ops4.6 VS DeepSeek V4,就是说:谁是真正的编程之王?!当时我曾答复:待DeepSeek V4于3月初公布编程评测结果后再进行点评。现在看来要等到claude与V4 测评结果完全可比性可能待时较长,不如现在先来一个初评。

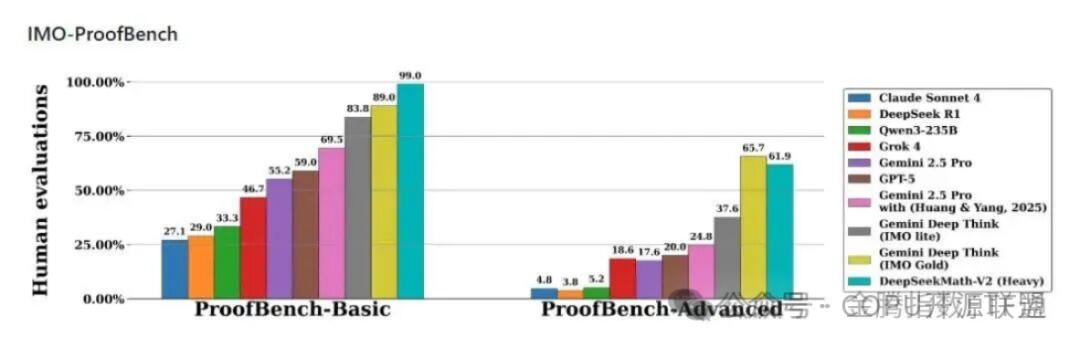

Anthropic的Claude系列模型,凭借其在编程场景的早期布局和持续深耕,在当前的编程能力评测中保持领先地位,在今年2月多项权威评测中,成绩亮丽,表现突出:在Arena ai三大竞技场(代码、文本、专家)全部登顶第一,代码竞技场比前代暴涨106分,EPochA前沿数学评则:Tier 1-3级别得分40%,Tier4(极难)级别得分21%)在统计学上追平GPT-5.2, Terminal-Bench2.0获得最高分,能出现数百万行代码库迁移。Deepseek在编程方面也是早有布局、持续深耕,并在模型架构创新和增效上富有特色。发展多模态长上下文窗口期,-V2、-V3、-R1、-V3.1、V3.2、Math V2,到-V4持续深耕,-V2:每百万token仅1元,-V3.2:每百万token仅3元,-V4/Engram可将原始128k语言压缩23%等等。

据讯:DeepSeek MODEL1经内部测试,在编程和教学领域,超越Claude和GPT系列。(而MODEL1一度传为-V4的内部代号)

五、AI发展前景

美国AI巨头更侧重硬件绑定的AI发展路径,中国企业在软件优化上的深耕,或许会走出一条更具普惠性的AI落地的发展之路。中国企业需要继续深耕技术,同时积极参与全球规则的制定,才能在这场长期竞争中占据主动。从这场东西方争夺编程王冠看来,全球AI格局又一转折点,大概率会从美国独大转向中美并立的局面。

2. 会上陆主席请袁怿就以上内容发表了意见:

DeepSeek与北大合作的DualPath论文,原文的arxiv id为2602.21548。目前在论文原文中或github上疑似没有搜到DeepSeek-AI下的开源代码仓库(官方实现目前疑似还没有公开在网上)。其工作位置主要在模型启动器中,服务于大模型推理。从论文的部分配图来看,主要讨论的是GPU上的任务调度问题。从而使得GPU在同样的时间内可以完成更多的任务。

单个agent和多agent的关系 —— 上下文>业务流程

从Anthropic的公开博客,文章,Github上的项目案例来看。Anthropic发布了一系列智能体系统开发的方式。

①Skill更加倾向于成为一种语言定义工作流系统,以语言描述的方式定义工作流,不同于dify,langchain通过代码或所见即所得工作流。

②参考Anthropic长时间智能体和多智能体的文章,Anthropic将上下文工程和业务流程相契合,以上下文为中心的分解。按上下文边界划分意味着处理某个功能的智能体也应该处理其测试,因为它已经具备了必要的上下文。只有当上下文能够真正隔离时,才应该拆分工作。解决单智能体的问题后,从业务流程的角度思考不同智能体之间的交互方式。

3. 会上发表《DeepSeek V4延期真相:是为了跳过英伟达等华为!》

《DeepSeek V4延期真相:是为了跳过英伟达等华为!》

谭中意,2026.2.27

DeepSeek缺席春节,是一种主动选择。

这个春节,在所有人都盯着DeepSeek,会不会再度搞事情的时候,DeepSeek罕见地保持了沉默。如果你以为DeepSeek V4只是一次常规的模型迭代升级,那就大错特错了。这背后,是中国AI产业一次意义深远的战略调整。

(一)打破行业惯例:英伟达被“跳过”了

就在最近,有知情人士透露,DeepSeek已提前向华为等国内芯片厂商开放了V4的访问权限,供其进行软件适配和性能优化。与此同时,V4 Lite版本正在密集测试中,代号“sealion-lite”,拥有100万个token的超长上下文窗口,并且是原生多模态架构。

值得细看的是DeepSeek做的那个选择。行业惯例是这样的——大模型发布前,会先给英伟达、AMD这样的头部芯片厂商提供预览版,让他们有足够时间做软件适配,确保模型在主流硬件上能高效运行。DeepSeek之前和英伟达团队也保持着密切合作,这是一条走了很久的路。

但这次,DeepSeek没有这么做。它把那个窗口期留给了华为昇腾,以及其他国内芯片厂商。这中间差的那几周,V4一再延迟,外界多有猜测,现在答案基本清晰了:不是技术上出了问题,而是在等国产GPU把适配工作做到位。

据路透社今日报道,近期,DeepSeek已将重大更新版本V4向华为等国内供应商提供提前访问权,以支持其优化处理器软件,确保模型在硬件上高效运行。但英伟达、AMD等芯片厂商还未获得权限。

▲路透社报道截图

(二)信号太重要了:国产AI生态正在形成

这一步走出去,意义完全不同。从技术竞争的角度往深里想,中国AI的最大隐患一直不在模型能力上,而在硬件。

训练靠算力,推理靠算力,规模化落地靠算力。算力卡在英伟达手里,等于整条产业链有一个关键节点捏在别人手里。这个问题喊了很多年,但真正能检验的,是在顶级模型上跑通。

DeepSeek V4选择先适配华为昇腾,不是一个简单的商业决策,而是一个系统性的信号——从模型到芯片,这条链路在被认真打通。这不是哪一家公司单独做到的,华为、DeepSeek,以及背后无数做适配工作的工程师,这是一个众志成城的结果。长期来看,经济层面的价值难以估量。

对英伟达来说,这件事的冲击远不只是在中国市场失去一些份额。在全球范围内,英伟达的护城河建立在两件事上:最强的GPU性能,以及围绕CUDA建立起来的软件生态。前者暂时还有优势,但后者的壁垒正在被一点一点侵蚀。

当顶级中国模型开始跑通国产硬件,这个示范效应会向外辐射——其他国家和地区的AI团队会开始认真评估替代选项。英伟达面对的,是一个真实的全球性竞争对手正在成型。

(三)V4的技术突破:两个关键数据

再说V4的技术参数,这两个数据不是噱头。100万token的上下文窗口,这是Google Gemini级别的能力。它意味着什么?意味着你可以把一整部法律文书、一份完整的财务报告、一个复杂项目的全部代码库,一次性塞进去让AI读懂并处理。

这种能力打开的应用场景,是之前根本做不到的。长文本理解、长程推理、深度文档分析,这些需求之前只能切片处理,从来都是凑合着用。

多模态是另一个大补丁。这是DeepSeek被竞争对手诟病了将近半年的地方。豆包、Gemini、ChatGPT早就上线了图文混合输入、视频理解、语音交互这些能力,在用户体验上拉开了相当明显的差距,也吸引了大批不同类型的用户进来。

DeepSeek作为底层基座,多模态能力缺席意味着整个应用生态都受限。现在这两个短板如果同时补上,DeepSeek作为基模的应用覆盖面就会有质的提升。

(四)成本优势依然明显

值得注意的是,DeepSeek V4延续了高性价比路线。据报道,V4将维持成本优势,并通过Engram架构进一步降低HBM使用率(从100%降至约75%)。这意味着一个初创团队用DeepSeek的成本,可以调用20-50倍于OpenAI的token量。对于代码生成这种token密集型任务,成本差距被进一步放大。

2025年2月底,R1石破天惊地打开了局面,创下了中国AI模型前所未有的高度。自此,DeepSeek公众热度曲线一路向下,再也未能复现年初的辉煌。

DeepSeek R1的影响力,不用赘述,问世之后长达数月的时间里,创造了消费级AI应用增长速度的新纪录,全国各地也都在反思和探讨,为什么自己没能孵化出幻方量化这样的科技企业。这种现象级的社会影响力,至今都是独一无二的。

但后续发布模型的热度,都无法跟R1相比。是DeepSeek的技术产品力不行了吗?

并不是。

应用层面,DeepSeek的留存率和日活量仍稳居AI应用榜单前列,与第二梯队形成了断层式的领先优势,说明用户并没有大规模流失。

技术层面,DeepSeek在2025年保持着高频的模型迭代。2025年3月24日,DeepSeek-V3-0324发布;5月,旗舰模型R1完成迭代升级;9月29日,首个垂直领域专业模型DeepSeek-OCR发布;11月27日,推出第二代数学专业模型DeepSeekMath V2。在顶级大模型竞赛中始终位于第一梯队,技术创新也没有停滞。

行业影响力方面,DeepSeek积极与华为昇腾、寒武纪等国产AI芯片厂商展开深度合作,比如与昇腾达成了“Day0适配”,新模型当天上线,企业当天就能在国产算力上跑起来,避免了“模型有了、算力跟不上”的尴尬。从这个角度来看,大众对DeepSeek解决算力问题的期待,其实也已经兑现。只不过AI应用浪潮全面兴起,使得算力总需求大幅激增,才让大家感觉算力仍然很紧缺。

既然产品没走下坡路,为何DeepSeek无法复刻2025年初的盛况?这应该是幻方量化的主动选择。

(五)市场已经做出反应

这一切的一切都已经呼之欲出了。或许就在下周的黄金时间段啦!

市场对此已经做出反应,相关概念股开始蓄势待发。

当然,目前这些都是知情人士的消息,正式发布之前的数据都可能有出入。但时间窗口很近,本周可能就有答案。

值得等。这不仅是一个模型的发布,更是中国AI产业自主可控迈出的关键一步。当模型与芯片的协同效应开始显现,我们迎来的将是一个全新的AI时代——一个不再受制于人的时代。

4.会议上发表一则简讯:

据悉,开源捐赠基金会(Open Source Endowment )官宣成立,众多开源大佬和顶级VC官宣加盟,探索永久解决开源软件资金困境,目标筹集1亿美金,来给独立开源维护者提供资金支持。目前已经募集75万美元。

参考链接:https://endowment.dev/

5. 陆主席指示谭中意,继续推进跟沙特的开源合作工作,可以建立开源创新中心,包括向沙特推荐优秀开源项目,与此同时,可协助沙特建设开源起步产业)。中意表示,正在紧密沟通,陆主席要求先提出规划设想。

参会人员:陆首群、孟迎霞、张侃、章文嵩、王珊、袁怿、谭中意、安泱、鞠东颖、靳虹博(线上)、陈伟(线上)、程海旭(线上)、胡宇(线上)、韩宪平(线上)、Anna.AI(线上)。