COPU会议纪要丨2025.12.23

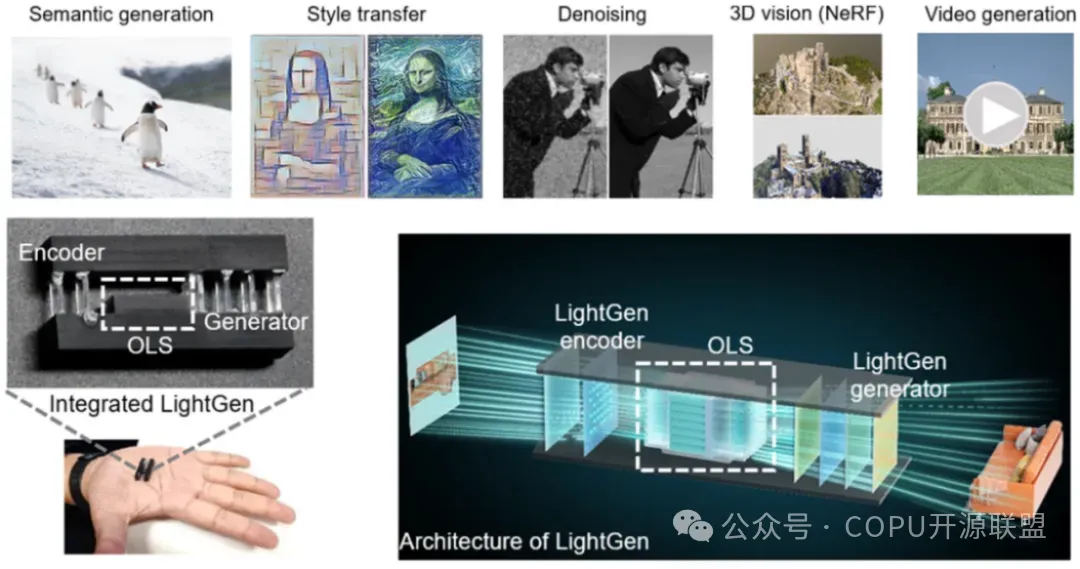

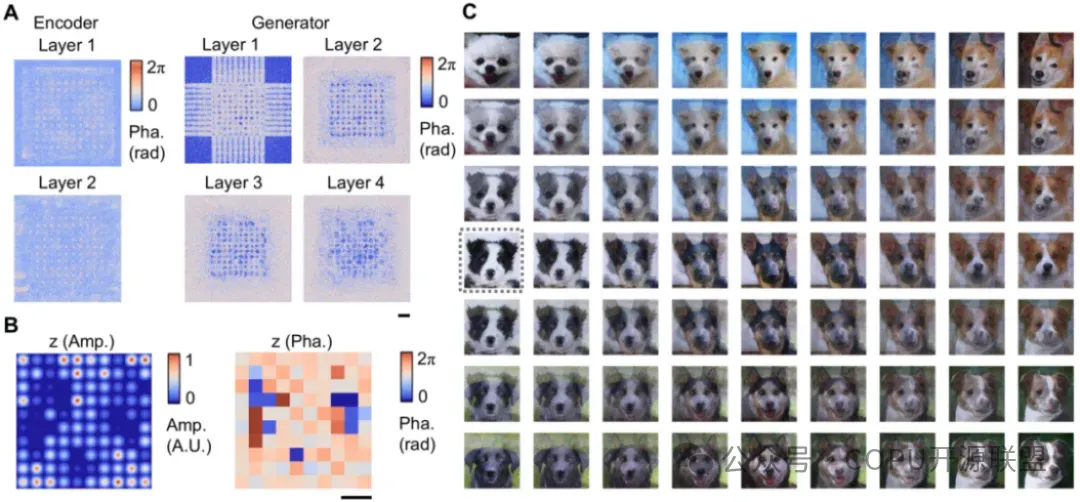

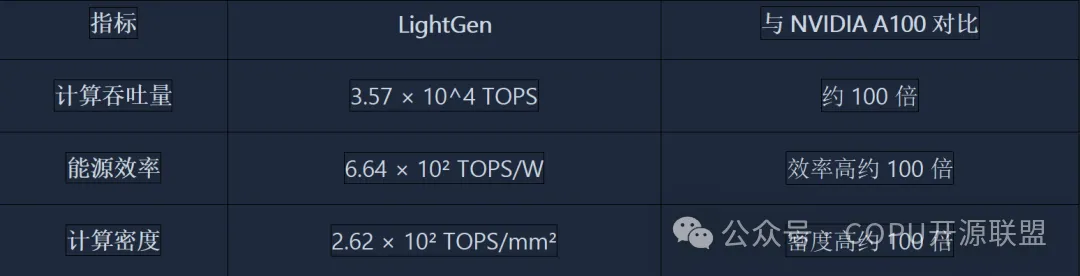

本次会议将发表陆主席的《二评Deep Seek》。 《二评Deep Seek》 陆首群 2026.12.19 深度求索公司的梁文锋团队于去年12月26日发布了DeepSeek-V3,又于今年1月20日发布了DeepSeek-R1,出现了震惊硅谷、震惊世界的局面。当时也有人对DeepSeek的价值产生怀疑或迷蒙,为了与这些人澄清并探讨DeepSeek的发展问题我曾发表了一篇《评DeepSeek》的文章(发表在GitHub、Hugging face及Gitee、Gitcode上),全文提出了六个论点。迄今近一年时间了,我感到有必要结合DeepSeek与其他大模型的发展近况来分析其发展前景,也有必要检验分析我的这篇文章中提出的论点是否恰当?! 论点一:梁文锋团队研发出一条“低投资、低成本、有限资源、高效率、高性价比(产出)发展人工智能的新路径。 DeepSeek堪称当前中国人工智能的代表作,正在改变世界人工智能的发展格局。 二评分析: ① 初,这是一年前震惊硅谷、震惊全球的主流意见。 ② 中,今年10月9日,我与DeepSeek的AI专家对全球十大顶尖大模型进行交叉点评,我们取得了高度一致,其中在对DeepSeek大模型进行点评时,我点评的论点(见如上论点一)获得DeepSeek同行的认可,认为评论精辟,遵循客观事实。 ③ 近,最近(12月10日)梁文锋入选《Nature》“年度十大人物”(之一),其事绩就如上论点一所述。 论点二:DeepSeek实行全开源,即坚持开源创新,开源有助于人工智能的迭代创新、维护升级、开拓生态;DeepSeek将大模型C端全开源和B端实行开源商业模式铸成一体,不但有助于开源创新,并可支持开源产业的发展,这也是DeepSeek开源的商业模式的一大创新。 二评分析:尚未见到DeepSeek的开源主体与开源社区透明的组织、联动方式,似乎有待改进。 在10月9日与DeepSeek的AI专家讨论时,他谈到因DeepSeek实行开源也产生一些负面影响,如泄漏一些技术,提高了国内外同行的竞争力,(如何改进尚待处理) 论点三:现有大模型的产品排名榜,似乎使DeepSeek处于不利状态,其实DeepSeek的产出性能与其他顶尖大模型处于对等状态,不存在过分夸张的你高我低的情况;如以更科学的性价比对比,DeepSeek肯定天下第一(以性价比作对比,也是Geoffrey Hinton大师的主张)。 二评分析:其实影响DeepSeek排行榜位置下降的尚有其他因素,如:DeepSeek开发多模态落后于其他顶尖大模型,智能体(agent)觉醒较慢,深度推理模型也稍逊于GPT-5,开发通用人工智能(AGI)也慢了一步,目前GPT-4中的AGI达27%,GPT-5中的AGI达57%,梁文锋虽然于3月23日《今日头条》上发表他重视通用人工智能(AGI),但毕竟慢了一步。 论点四:目前DeepSeek拥有的主要技术已无秘密可言,在展开下一阶段AI竞争时,大家处于同一起跑线上。DeepSeek问世引发了全球人工智能的白热化竞争。 二评分析:确实如此,近期Open AI的GPT-5.1,谷歌的Gemini-3pro,XAI的Grok4.1,Anthropic的Claude-opus4.5均在争排行第一,未知DeepSeek-R2竟是如此难产!! 论点五:目前包括DeepSeek在内的各种大模型都是一种生成式自回归语言大模型,不是真正的人工智能,由于它并不理解物理世界,缺乏本地和世界知识,对于深度记忆也成问题,不可避免存在语言大模型那些局限性和产生幻觉那样的负面缺陷,需要向通用人工智能(AGI)目标实行纠偏转轨。 在实现AGI之前必须跨越多模态、具身智能、AI Agent、世界模型等过渡阶段(这些过渡阶段也是AGI的一部分)。 二评分析:DeepSeek已经向AGI纠偏转轨起步,也下力量研发如上所说的过渡阶段,为克服起步慢需加快研发步伐。 论点六:DeepSeek像其他标准、普惠的基座模型一样,难以直接转变为企业/行业的优质生产力,尚需提升其暂时缺失的商业价值,深入企业/行业,进行应用补缺。 二评分析:可发挥DeepSeek的开源优势,把社区志愿应用开发者和社会上的协作企业组织起来,选择有关企业/行业进行应用补缺。 本次会议发表由陈越摘译的《用于大规模智能语义视觉生成的全光合成芯片》。 北京时间12月19日,上海交通大学集成电路学院(信息与电子工程学院)陈一彤课题组在新一代算力芯片领域取得重大突破,首次实现了支持大规模语义媒体生成模型的全光计算芯片,相关研究以“All-optical synthesis chip for large-scale intelligent semantic vision generation”(大规模智能语义视觉生成全光芯片)为题发表于国际顶级学术期刊《科学》(Science)上,并被《科学》官方选为高光论文重点报道。 研究团队首次提出全光大规模语义生成芯片LightGen,这也是国际首次实现的大规模全光生成式AI芯片,在单枚芯片上同时突破了百万级光学神经元集成、全光维度转换、无真值光芯片训练算法领域公认的瓶颈。 图注△大规模全光生成计算芯片LightGen 论文实验验证了全光芯片LightGen在高分辨率(≥512×512)图像语义生成、3D生成(NeRF)、高清视频生成及语义调控、去噪、局部及全局特征迁移等多项大规模生成式任务。不再让电辅助光生成,而是让全光芯片完整实现输入图像、理解语义、语义操控、生成全新媒体数据的端到端过程,即让光“理解”和“认知”语义。 图注△LightGen生成的采样图像示例 此外,LightGen采用了极严格的算力评价标准,在实现与电芯片上运行的Stable Diffusion、NeRF、Style Injection Diffusion等前沿电子神经网络相仿生成质量的同时,直接测量整个系统端到端的耗时与耗能降低。实测表明,即便采用较滞后性能的输入设备,LightGen仍可在算力和能效上取得相比顶尖数字芯片2个数量级的提升。而如果采用前沿设备使得信号输入频率不是瓶颈的情况下,LightGen理论可实现算力提升7个数量级、能效提升8个数量级的性能跃升。这不仅直接体现了在不损失性能情况下替换顶尖现有芯片能获得的巨大算力和能效提升,也印证了解决大规模集成、全光维度变换、无真值光场训练等关键难点,全光片上实现大规模生成式网络的重要意义。 在受控基准测试中,LightGen展现了显著的速度、能效和计算密度优势。 图注△ 陈一彤 陈一彤博士长期致力于光计算领域的研究,聚焦新一代算力芯片切实应用时的核心科学难点问题,团队所提出的全模拟光电芯片ACCEL(Nature623 (7985), 48-57),国际首次实测验证了复杂智能任务中光计算的系统级算力优越性,将光计算芯片中的超高算力能效,无损地保留和接入复杂成熟的数字社会中。2023年,所提出的PED (Photonic Encoder Decoder,Science Advances 9(7), eadf8437)光计算架构,更被Science子刊认证为“国际首个全光生成网络(PED is the first demonstration of all-optical generative neural networks)”。基于上述研究基础,LightGen突破性将全光芯片的适用范围拓展到了大规模生成式神经网络,并已与工业界合作开展应用实践。 本次会上谭中意介绍了国内内源以及内源大会的情况。 内源中国大会 2025(InnerSource Summit China 2025)已圆满落幕,参与活动的有百度、华为、intel、汇丰科技、中国电信、金山、OPPO、信通院等。本次会议全面展示了内源的理念、历史、全球实践及其与AI等前沿技术的结合。多位行业领先企业分享了成功的内源落地案例和显著成效,证明了内源在提升研发效率、促进协作创新和加速数字化转型方面的巨大价值。未来 InnerSource Commons 基金会也将持续推进内源文化活动交流。通过坚持国际交流与本土实践相结合的策略,中国有望在全球 InnerSource 领域贡献独特的经验和洞见,推动技术协作和开放创新的新范式。 图注△ 内源大会现场 内源(InnerSource): 定义: 内源是指将开源软件的协作开发模式引入企业内部,促进代码共享和跨部门协作。 历史: 概念由Tim O'Reilly于2000年提出,2015年由Denise Cooper重新推广并建立InnerSource Commons社区和基金会。2025年正值该概念提出25周年及基金会成立10周年。 全球发展: 已在全球范围内(包括亚洲、美国等)得到发展,并被联合国等组织采纳。 会上陈道清与大家分享了华为星光大会相关情况。 2025华为星空开源大会以“开源开放,共建AI时代新生态”为主题,于12.19~12.20日在华为召开。大会汇聚了超20名业界专家、学者、开源先锋、企业以及开源基金会代表等,围绕AI、CANN等热点话题,共话开源技术突破、生态协同模式与产业落地机遇,凝聚产业合力,打造可持续发展的AI开源新生态。 CANN( Compute Architecture for Neural Network)是昇腾平台的异构计算架构,向下使能昇腾处理器的并行加速能力,释放硬件澎湃性能;向上提供统一编程接口及友好开发体系,支持用户快速构建基于昇腾平台的AI应用和业务。CANN将于12月30日前完成A2/A3的全面开源开放。 在今天的会议上,孟迎霞与会分享了于12 月 21 日在北京召开的全球开源商业创新大会(Global Open-source Business Innovation Conference)情况(简称“GOBI 2025”)。 大会由 Upstream Labs、AI 原点社区、CSDN 联合主办,以“释放源力,创造未来”为主题,将“开源、商业、AI”三股力量汇聚同一舞台,展开面向全球的开源商业创新趋势的洞察与产业实践讨论,并就开源创新如何真正转化为可持续产业价值进行深入探讨和案例分享。线下超500位开源领袖、独角兽创始人、顶级 VC、产业高管、政策制定者和一线开发者齐聚北京,线上直播总观看人数超 3.6 万。GOBI 2025 全球开源商业创新大会虽已落幕,但关于开源、商业与 AI 的讨论仍在持续热烈进行。从技术实践到商业模式,从创新思维到社会影响,在这个充满机遇的时代,开源创新与 AI 技术正深度融合,推动创业者和开源企业不断突破边界、跃升商业与产业价值。 图注△ GOBI大会现场 在本次会议上章文嵩介绍由北京大学计算机学院杨智副教授团队(王磊和程羽为核心开发成员)主导开发的TileLanguage(tile-lang),这是一种简法的领域专用语言,也是一款开源的AI算子编程语言。 TileLang 旨在简化高性能 GPU/CPU 内核 (Kernels)的开发,例如 MLA(Multi-Head Latent Attention)、GEMM(GEneral Matrix Multiplication)、Dequant GEMM、FlashAttention 和 LinearAttention 等。通过在 TVM 之上构建底层编译器基础设施,并采用 Pythonic 语法 ,tile-lang 使开发者能够专注于提升开发效率(门槛较低、易用 ),而无需牺牲实现最佳性能所需的底层优化。 TileLang 的核心价值在于能够将高级数据流描述自动转换并优化为高效的底层代码 (如 CUDA C/C++、Ascend C 等)。值得一提的是:华为昇腾通过 PTO (Parallel Tensor/Tile Operation)编程范式,已成功适配 TileLang 的 Sparse Flash Attention 和 Lightning Indexer 算子,并进行了相应优化,进一步提高昇腾融合算子的编程易用性。 参会人员:陆首群、宋可为、章文嵩、安泱、谭中意、张侃、陈道清、孟迎霞、孟伟、鞠东颖、刘澎(线上)、陈钟(线上)、陈伟(线上)、程海旭(线上)、袁怿(线上)、胡宇(线上)、韩宪平(线上)、靳虹博(线上)、Anna.AI(线上)。